「ChatGPT API 活用」で調べているあなたは、きっとこう感じていませんか?

“APIとは何かは何となく分かる。でも、結局できることは?ChatGPT(画面)との違いは?個人利用でも現実的に使える?そして、API連携まで含めてどう始めれば失敗しない?”――情報が多すぎて、最短ルートが見えにくい状態です。

この記事では、そのモヤモヤを一気に解消します。結論はシンプルで、ChatGPT APIは「文章生成ツール」ではなく、業務や作業の流れに組み込む“部品”です。だから成果が出る人は、モデル選びより先に「入力をそろえる→出力の形を固定する→チェックして保存/連携する」という運用の型を作っています。

本文ではまず、APIとは何かと、ChatGPT(ブラウザ)との違いを1分で整理。次に、要約・抽出・分類・翻訳などのできることを、すぐ真似できるAPI活用事例で具体化します。さらに「API 使ってみた:30分で動かす最小構成」として、キー管理・よくあるエラー・ログの残し方までセットで解説。最後に、ツール/関数呼び出しやRAGなどAPI連携の種類を、失敗しない順番(読む→書く→確認つきで書く)でまとめます。

読み終える頃には、あなたの状況が個人利用でも業務でも、「何から始め、どう広げ、どこで人が確認すべきか」が一本の線でつながります。結果として、文章作成や整理にかかる時間が減り、手戻りが減り、仕組みとして再現できる――その“勝ちパターン”を持ち帰れるはずです。

- ChatGPT API 活用の全体像

- 最短で「使ってみた」まで到達する手順

- 失敗しない業務組み込みの設計

ChatGPT API活用で「何ができるか/どう使うか」を最短で理解する

- ChatGPT APIとは

- ChatGPT API 使ってみた:30分で動かす最小構成

- ChatGPT API活用事例:個人利用〜業務効率化〜サービス組み込み

- ChatGPT API 違い:ChatGPT/ChatGPT API/Responses APIの位置づけ

- ChatGPT API連携:種類(ツール/関数呼び出し)と連携パターン

ChatGPT APIとは

ChatGPT APIを活用すると、社内のツールや業務システムの中に「文章を作る・まとめる・必要な部分だけ抜き出す・仕分ける」力を組み込めます。うまくハマると、文章作成の時間が大きく減り、品質も上がりやすいことが実験研究で示されています。たとえば文章タスクでは、平均の作業時間が約40%短くなり、出来上がりの質が約18%上がったという結果があります。

一方で、うまくいくかどうかは「何を入力し、どんな形で出力し、最後にどうチェックして保存するか」という流れを作れるかで決まります。APIは便利ですが、データの準備やチェック体制が弱いと失敗しやすいという指摘もあります。

ChatGPT(ブラウザ)とAPIの違いを1分で整理

ChatGPT(ブラウザ)は、すでに完成している「チャットの画面」を使って人が直接やり取りするものです。いっぽうAPIは、あなたの会社のアプリやExcel処理、社内ツールなどから、プログラムで呼び出して使うための「接続口」です。会話の履歴(メッセージの並び)を送ると、モデルが返事を返す、という考え方が基本になります。

もう1つ大事なのがデータの扱いです。OpenAIの案内では、2023年3月1日以降、OpenAI APIに送ったデータは、明示的に同意して共有しない限り、学習(モデル改善)には使われないとされています。

違いをイメージしやすいように、要点を表にまとめます。

| 観点 | ChatGPT(ブラウザ) | ChatGPT API |

|---|---|---|

| 使い方 | 画面に入力して会話する | プログラムから呼び出して処理する |

| 目的 | 個人の作業を手早く助ける | 業務フローに組み込んで動かす |

| 出力の形 | 文章が中心 | 文章+決まった形(例:JSON)にしやすい |

| データの扱い(基本方針) | 設定やプランで扱いが変わる | 原則「学習に使わない(同意した場合を除く)」 |

APIでできること

APIは「文章を作る」だけではありません。入力した文章から、短くまとめたり、必要な情報だけ抜き出したり、カテゴリ分けしたり、翻訳したり、会話としてやり取りしたりできます。OpenAIのドキュメントでも、生成、要約、会話など幅広い用途が説明されています。

さらに、仕事で使うときに強いのが「決まった形で返す」ことです。たとえば、必ず指定したJSONの形で返すようにできる機能が用意されていて、後ろの処理(保存や集計)が安定しやすくなります。

業務でよくある入出力の例を、表にします。

| やりたいこと | 入力の例 | 出力の例 | なぜ便利か |

|---|---|---|---|

| 生成 | メールの要点、条件 | 下書き文章 | 0から書く時間を減らせる |

| 要約 | 議事録、長文資料 | 200字要約、重要点 | 読む量を減らし、判断を速くする |

| 抽出 | 請求書文、問い合わせ文 | 日付、金額、要望など | 手入力を減らしミスも減らしやすい |

| 分類 | 問い合わせ文 | 「返品」「不具合」など | 振り分けを自動化しやすい |

| 翻訳 | 日本語文 | 英語文など | 多言語対応を速くできる |

| 対話 | これまでの会話 | 次の返答案 | チャットボット等にできる |

業務に組み込むと何が変わる

業務に組み込むと一番変わるのは、「毎回、人が手でやっていた文章作業」を、一定のルールで回せることです。実験では、文章作成のような仕事で、ChatGPTを使った人は平均の作業時間が約40%短くなり、成果物の質が約18%上がりました。

また、実際のカスタマーサポートの現場データを使った研究では、AIの提案を使えるようにした結果、1時間あたりの解決件数が約13.8%増えました。特に経験が浅い人では改善が約35%と大きく、離職(やめる人)も約8.6%低かったという報告があります。

「標準化」という点では、出力を決まった形にそろえる仕組みが効きます。たとえば、JSONスキーマに必ず合うように出す機能を使えば、項目の抜けや形の崩れが起きにくくなり、次の工程(保存、集計、通知)が安定します。

向いているケース/向かないケース

向いているのは、「正解が1つに決まらない文章系の仕事」や「下準備や下書きを作って、人が最後に確認する仕事」です。実際、企業調査では、生成AIの出力をどう監督するかは会社によって差が大きく、全ての出力を人が確認する会社が27%ある一方で、確認が20%以下という会社も同じくらいある、と報告されています。つまり、チェックの設計が成果を分けます。

向かない(または工夫が必要)なのは、入力データがバラバラで整っていない、ミスが許されないのにチェック工程が作れない、費用対効果の目的があいまい、といったケースです。Gartnerは、データ品質の問題やリスク管理不足、コスト増、価値が不明確などを理由に、概念実証の後に生成AIプロジェクトの少なくとも30%が2025年末までに中止される、という予測を出しています。

判断を助けるために、考え方を表にします。

| 判断ポイント | 向いている状態 | 向かない状態 |

|---|---|---|

| 入力 | ある程度そろっている、目的が明確 | 何が正しい入力か決まっていない |

| 出力 | 形式を決められる、確認できる | ミスが即事故なのに確認できない |

| 運用 | 人の最終チェックやログ管理がある | だれも責任を持たず放置される |

| 価値 | 時間短縮、品質向上など測れる | 何が良くなったか測れない |

活用の全体フロー

活用の流れは、とてもシンプルに言うと「入力をそろえる、生成する、形を整える、保存して次の作業につなぐ」です。ここで大事なのは、生成の前後に“仕事の仕組み”を入れることです。

たとえば、入力では「何を渡すか」を固定します。生成では「どんな役割で、どんな形で返すか」を指定します。後処理では、JSONなど決まった形にして、必須項目がそろっているかを機械的にチェックします。ここでStructured Outputsのような仕組みを使うと、形が崩れにくくなります。

最後に保存や連携です。メール下書きなら下書きフォルダへ、問い合わせ分類ならチケットシステムへ、要約なら議事録データベースへ、という具合に「置き場所」を決めます。そして、人の確認が必要な場所は必ず残します。実際、企業調査では出力のレビュー割合が大きく割れており、運用設計が現実に重要だと分かります。

まとめ

ChatGPT APIは、チャット画面で使うChatGPTとは違い、社内の仕組みの中から呼び出して仕事を回すための接続口です。要約や抽出、分類、翻訳などもでき、出力を決まった形にそろえる機能を使うと業務に乗せやすくなります。

研究では、文章作業の時間短縮や品質向上、サポート業務の生産性向上などが数字で示されています。

ただし、データ品質、目的の明確さ、チェック体制が弱いと失敗しやすいという予測もあります。入力→生成→後処理→保存/連携の流れを作り、人が見る場所を決めてから始めると、活用が安定します。

ChatGPT API 使ってみた:30分で動かす最小構成

ChatGPT APIは、たった1つの「APIキー」と短いコードで、あなたのPCや社内システムから文章生成を動かせます。初心者が30分で成功しやすい最小構成は、「キーを安全に持つ」「公式SDKで最小リクエストを投げる」「つまずきポイント(エラー・速度・ログ)を先に用意する」の3点です。

特にキー管理は最重要です。公開リポジトリ上で見つかった“秘密情報(キーなど)”は、1年で約369万件が検出され、前年より25%増えたという報告があります。 さらに実際の侵入でも、盗まれた資格情報が最初の入口になった割合が22%という調査結果があります。 だからこそ、最小構成でも「安全な保管」と「ログ」が成功体験を支えます。

APIキー準備と安全な保管

キーの流出は“よく起きる事故”だからです。公開ソース上で検出された秘密情報が約369万件、しかも増加傾向というデータは、うっかりが現実に多いことを示します。 侵入の入口として盗まれた資格情報が22%という調査もあり、キーが漏れると被害につながりやすいです。OpenAIも、キーをコードや公開場所に置かず、安全な場所に保管し、環境変数や秘密情報管理サービスで渡す考え方を示しています。

まず「キーをブラウザやスマホアプリに入れない」を徹底します。OpenAIは、クライアント側にキーを置くと悪用されやすいので、必ず自分のサーバー側で呼び出す方針を示しています。 次に、開発PCでは環境変数で渡し、チームや本番では“人ごと・用途ごとにキーを分ける”発想にします(使い回しを減らす)。OpenAIはチーム内でもキー共有を避け、個別のキー運用を勧めています。 そして「権限」としては、使う範囲が広すぎないようにプロジェクトを分け、追跡できる形にしておくと後が楽です。OpenAIは、APIキーの利用状況をダッシュボードで追跡でき、追跡が有効になるキーの条件(特定日以降のキーは追跡が標準で有効)も示しています。

SDK導入〜最小リクエスト

最小構成は「みんなが使っている言語」で始めるほど成功しやすいからです。開発者調査では、JavaScriptが66%、Pythonが57.9%と利用率が高いことが示されています。 OpenAIの公式クイックスタートも、Node(JavaScript)とPythonで、短いサンプルコードを用意しています。

Pythonでの最小“Hello World”はこれで動きます。環境変数にキーが入っている前提です。

# example.py

from openai import OpenAI

client = OpenAI()

response = client.responses.create(

model="gpt-5.2",

input="小学生にもわかる言葉で、APIって何か1文で説明して。"

)

print(response.output_text)インストールは公式の案内どおりで大丈夫です。

pip install openaiNodeでも同じ考え方で最小構成が組めます。公式クイックスタートに同等の例があります。

よくあるエラー対応

初心者が止まりやすいのは「認証(401)」「混み合い・制限(429)」「入力ミス(400)」だからです。OpenAIは代表的なエラーコードと原因、対策を整理して公開しています。 さらに、盗まれた資格情報が侵入の入口になった割合が22%というデータを見ると、401を“ただのミス”で終わらせず、キーの扱いも同時に点検する価値があります。

まず401が出たら「キーの打ち間違い」「余計な空白」「別の組織・プロジェクトのキー」を疑い、キーを作り直して差し替えます。 次に429が出たら、短時間に送りすぎです。OpenAIは429に対して、リクエスト間隔を空けることや、待って再試行することを推奨し、リセットの目安が「1分」と説明しています。 入力ミス(400系)は、足りない項目や形式違いが原因になりやすいので、まずエラーメッセージをそのまま読み、送った値をログで見返せるようにしておきます。

Pythonでの最小の例外処理は、次のように“止まり方を分ける”だけでも効果があります。

from openai import OpenAI

from openai import RateLimitError, AuthenticationError, BadRequestError

client = OpenAI()

try:

r = client.responses.create(model="gpt-5.2", input="こんにちは")

print(r.output_text)

except AuthenticationError:

print("認証エラー。キーの間違い、空白、無効化を確認してね。")

except RateLimitError:

print("混み合い or 送りすぎ。少し待ってから再試行してね。")

except BadRequestError as e:

print("入力ミスの可能性。送った内容とエラー内容を見比べてね。")

print(str(e))ストリーミングで体感速度を上げる

体感速度は“数字で決まる”部分があるからです。使いやすさの研究では、0.1秒は「すぐ反応した」と感じる目安、1秒は「考えの流れが切れない」目安として示されています。OpenAIも、ストリーミングは全体の生成時間を短くするものではない一方で、最初の文字が出るまでの時間を短くして、待ち時間のストレスを減らせると説明しています。

、チャットUIでは「完成まで待つ」より「出てきた分から表示する」ほうが気持ちよく使えます。Python SDKでは、stream=Trueでイベントが順に流れてきます。 まずは“表示するだけ”の最小から始めると成功しやすいです。

from openai import OpenAI

client = OpenAI()

stream = client.responses.create(

model="gpt-5",

input=[{"role": "user", "content": "短い自己紹介をして。"}],

stream=True,

)

for event in stream:

# まずは全イベントを眺める。慣れたら文字だけ拾う。

print(event)ログに残すべき項目

トラブルは“あとから調べる時間”がとても長いからです。大規模調査では、侵害を見つけるまで平均194日、封じ込めまで平均64日というデータが示されています。 被害額も世界平均で約488万ドルという報告があります。 だから、最初からログを薄くても残しておくことが、結果的に時間とお金を守ります。ログ管理の考え方自体も、公的機関がガイドとして整理しています。 さらにOpenAI側でも、キーの利用状況を追跡できる仕組みがあり、追跡が有効になる条件が明記されています。

“最小セット”は「誰が」「いつ」「何を投げて」「どれだけ待って」「どうなったか」が分かる情報に絞ります。たとえば次の表の項目があると、後で詰みにくいです。

| 目的 | これだけ残す | なぜ助かるか |

|---|---|---|

| 追跡 | 時刻、ユーザーID(または社内の識別子)、プロジェクト名 | どの操作が原因か探せる |

| 再現 | モデル名、入力の文字数(またはトークン数)、出力の文字数 | “同じ条件”を作り直せる |

| 速度 | 最初の表示までの時間、全部出るまでの時間 | 体感が悪い原因を切り分けられる |

| 障害 | エラーコード、再試行回数、待った秒数 | 429などの対策が打てる |

| コスト | 1回あたりの概算費用、日別の合計 | 予算オーバーを早めに気づける |

ログの中身は、入力全文をそのまま残すと個人情報が混ざりやすいので、最初は「長さ」や「要約した短いメモ」にしておくと安全寄りです。キーや個人情報はログに絶対入れません。

まとめ

ChatGPT APIを初心者が最短で動かすコツは、動くコードより先に「キーの安全」「エラー対応」「ログ」を小さく用意することです。秘密情報の流出は現実に多く、公開リポジトリで検出された秘密情報が約369万件、侵入の入口として盗まれた資格情報が22%というデータもあります。

公式SDKの最小例をそのまま動かし、401と429の対策を先に作っておくと、止まりにくくなります。 体感速度はストリーミングで改善しやすく、0.1秒と1秒という“人の感じ方の目安”も意識するとチャットUIが作りやすいです。 最後に、最小ログだけでも残せば、困ったときに原因が追いやすくなります。

ChatGPT API活用事例:個人利用〜業務効率化〜サービス組み込み

ChatGPT APIの活用事例は、大きく分けると「文章を作る」「長い文章を短くする」「必要な情報だけを取り出して形をそろえる」の3つです。これを業務に入れると、メール返信や問い合わせ対応が速くなり、議事録や社内FAQが作りやすくなり、データ入力の手間とミスも減らせます。

実際に、チャット型の顧客対応でAI支援を入れた研究では、1時間あたりに解決できる件数が14%増えたと報告されています。 文章作成でも、作業時間が短くなり品質が上がったという実験結果があります。さらに、日々の仕事は会議やメールで細かく中断されやすく、集中しにくいというデータもあるので、短時間で「下書き」や「要点」を出せる仕組みは効きやすいです。

問い合わせ返信・メール文面生成

メール対応は時間を取りやすいからです。調査では、知識労働者が仕事時間の約28%をメール対応に使っているという推計があります。 また、仕事中は会議やメールなどで2分ごとに中断され、1日で275回の中断になるというデータもあります。こういう環境では、毎回ゼロから文章を考えるより、型を決めて早く整えるほうが負けにくいです。

よくある返信は「型」を先に作っておくと安定します。次の表は、そのままコピペして中身だけ入れ替えられる最小テンプレです。

| 場面 | 返信テンプレ(例) |

|---|---|

| 受け取り連絡 | {お名前}様。お問い合わせありがとうございます。内容を確認しました。{いつまで}に回答します。急ぎの場合は、追加で次の情報を教えてください。{追加で必要な情報}。 |

| 追加確認 | {お名前}様。内容を正しく確認するために、次の点を教えてください。{質問1}。{質問2}。わかる範囲で大丈夫です。 |

| 対応完了 | {お名前}様。ご連絡ありがとうございます。今回の件は、{結論}で対応できます。手順は次の通りです。{手順の短い説明}。うまくいかない場合は、{確認ポイント}を教えてください。 |

議事録要約・要点抽出

会議まわりの情報は増えやすく、読む時間が足りなくなるからです。会議やメールなどで2分ごとに中断され、1日で275回の中断になるというデータがあります。さらに会議の60%が「突然入る会議」だとされ、予定が崩れやすいことも示されています。 だからこそ、議事録は「全部読む」より「決まった形の要点」を先に出すほうが現実的です。

「固定フォーマット」で出すと、読む側も作る側も楽になります。次の表の形にそろえるだけで、会議の中身が追いやすくなります。

| 項目 | 書く内容の例 |

|---|---|

| 決まったこと | 何をするか、いつからか、どう決めたか |

| 宿題 | やること、担当、期限 |

| 保留 | まだ決まっていない点、次回までの確認事項 |

| 数字・条件 | 予算、人数、期限などの大事な条件 |

| 次回 | 次の会議の日時、目的 |

社内FAQ/ナレッジ整備

社内で「情報を探す時間」が大きいからです。推計では、仕事時間の約20%を社内情報の検索や、詳しい人探しに使っているとされています。 つまり、FAQや手順書が増えて探しやすくなるだけで、ムダ時間が減りやすいです。

問い合わせログやチャット履歴から「よくある質問」を集め、ChatGPT APIで下書きを作り、人が確認して公開する流れが作れます。公開後も、新しい質問が増えたら追記し、同じ意味のFAQが増えたら統合する、という更新が回しやすくなります。情報が探しにくい状態だと検索時間が増えやすいので、タイトルと答えの形をそろえるだけでも効果が出やすいです。

提案書・記事・SNS下書き

文章の下書きはAIが得意で、時間短縮の効果が数字で出ているからです。文章タスクの実験では、作業時間が約40%短くなり、品質が約18%上がったと報告されています。 また、仕事は中断が多く、会議直前の修正が増えるなど「急いで仕上げる」場面が起きやすいので、下書きの段階で型をそろえるほど品質ブレを抑えやすいです。

品質をそろえるコツは「前提を固定する」ことです。たとえば、提案書なら目的、相手、強み、条件、禁止事項を最初に入力として決めます。記事なら読者、言葉の難しさ、文字量、言ってよいことと言わないことを決めます。SNSなら文字数、語尾、絵文字の有無、炎上しやすい話題を避けるルールを決めます。こうした前提を毎回同じ形で渡すと、出力のブレが小さくなり、最後の人のチェックも短くなりやすいです。

データ抽出

人が手で入力する作業はミスが入りやすいからです。臨床研究のデータ処理をまとめた研究では、単回の手入力のエラー率が0.29%、二重入力でも0.14%という推計が示されています。 こうした小さなミスが積み重なると、後で直すのが大変になります。

問い合わせ文や請求書文のような文章から「日付」「金額」「会社名」「要望」などを抜き出し、最初から決まった項目で返すようにすると、CSVやDBに流し込みやすくなります。ChatGPT APIには、決めたJSONスキーマに合う形で出力させる考え方があり、項目の抜けや形の崩れを減らすのに役立ちます。 文章のまま保存せず、必要な項目だけを「箱」に入れて保存するイメージです。

まとめ

問い合わせ返信はテンプレを作ると速くなり、議事録は固定フォーマットにすると読みやすくなります。社内FAQは「探す時間」を減らす方向に効きやすく、提案書や記事の下書きは実験で時間短縮と品質向上が示されています。 、文章からデータを抜き出して形をそろえると、手入力のミスを減らす発想にもつながります。

ChatGPT API 違い:ChatGPT/ChatGPT API/Responses APIの位置づけ

「ChatGPT」「ChatGPT API」「Responses API」は、名前が似ているせいで混ざりやすいですが、役割ははっきり分けられます。ChatGPTは人が画面で使う“完成したアプリ”で、APIは自分のアプリや業務に組み込むための“部品”です。その部品の入り口として、今はResponses APIが新しい中心で、Chat Completionsは古い方式だけれど今も使える、という位置づけです。

「ChatGPT API」という呼び方で混乱しやすい点

まず「ChatGPT API」という言い方自体が、昔の呼び名の名残で混乱を生みます。OpenAIは2024年4月24日の更新で、「ChatGPT API」という名前は使わない(この記事内の“ChatGPT API”は当時のGPT系APIを指す)という趣旨を明記しています。

次に、お金の仕組みも誤解が多いです。ChatGPTの月額プランと、OpenAIのAPI利用料は別で、ChatGPTの有料プランに入っていてもAPI料金が“自動で込み”にはなりません。

最後に、ChatGPTは「画面・ファイル操作・便利機能まで含めた一式の体験」ですが、APIは「あなたのプログラムが、必要な形で呼び出して使う仕組み」です。つまり同じ“頭脳”っぽく見えても、提供の形が違うので、できること・作り方・責任の持ち方が変わります。

この違いを一枚で整理すると、次のようになります。

| 名前 | ざっくり言うと | だれが主に使う | 料金の考え方 |

|---|---|---|---|

| ChatGPT | そのまま使える完成アプリ | 個人・チーム | サブスク中心(プランによる) |

| (俗称)ChatGPT API | 呼び名があいまいで混乱しやすい言い方 | 会話で言いがち | 実体はOpenAIのAPI利用 |

| Responses API | 今の“おすすめ”のAPI入口 | 開発者・業務システム | 使った分だけ課金 |

Responses APIとChat Completionsの違い

結論から言うと、新しく作るならResponses APIが推奨で、Chat Completionsは既存資産や単純なチャット用途で“そのまま使い続ける”選択肢です。OpenAIのドキュメントでも、新規プロジェクトはResponsesを推奨すると書かれています。

違いの核は、「返ってくるもの」と「できることの広さ」です。Chat Completionsは“メッセージの配列”を送って“返事のメッセージ”をもらう形が中心です。一方Responsesは、メッセージだけでなく、道具の呼び出しやその結果なども含めた“いろいろな種類の部品(Items)”として扱う設計になっています。

またResponsesは、検索やファイル探索、パソコン操作などの“組み込みツール”を使う前提で作られていて、1回のリクエストの中で複数のツール呼び出しを回すような作りも想定されています。

さらに、OpenAIは内部テストとして、推論モデルをResponsesで使うとSWE-benchで同条件のまま約3%改善した、キャッシュ効率が40%〜80%改善してコスト面でも有利になる場合がある、と説明しています(これは“内部テスト”の数字です)。

使い分けを、現場目線でまとめるとこうです。

| 迷ったときの基準 | Responses APIが向く | Chat Completionsが向く |

|---|---|---|

| 新規開発かどうか | 新規は基本こちら | 既存の仕組みを大きく変えたくない |

| やりたいこと | ツール連携や多段処理も視野にある | まずは単純な会話生成だけで十分 |

| 将来の伸びしろ | これから増える機能を取り込みやすい | 仕組みは分かりやすいが新機能は相対的に少なめ |

状態管理(会話の持ち方)をどう設計するか

APIでつまずきやすいのが「会話の記憶をどこに持たせるか」です。ChatGPTの画面は、会話が自然につながって見えますが、APIでは“つながっているように見せる設計”を自分で決めます。

大きく考え方は2つあります。1つ目は、毎回これまでの会話を一緒に送る方法です。分かりやすい反面、会話が長くなるほど送る量が増えます。2つ目は、会話を“長く生きる箱”として持つ方法です。OpenAIはConversations APIがResponses APIと一緒に動いて、会話の状態を「消えにくいIDつきのオブジェクト」として保存できると説明しています。これなら、端末や時間が変わっても同じ会話を続けやすくなります。

さらにResponsesには、ターン間の状態を保つための仕組み(例として store: true の説明)があり、推論やツールの流れを保ちやすい、という位置づけも示されています。

初心者におすすめの考え方は、「短い作業は毎回まとめて送る」「長く続く相談や業務は会話IDで持つ」という切り分けです。こうすると、速さ・費用・作りやすさのバランスが取りやすくなります。

マルチモーダル(画像など)を扱うときの考え方

画像を扱うときは、「画像を見て説明する」のか、「画像を作る(生成する)」のかで道が分かれます。OpenAIの案内では、Responses APIは画像の入力を扱えて、画像の分析や、画像を出力する方向(生成)も含めた用途が説明されています。Images APIは主に画像を作る用途で、Chat Completionsは画像を入力として受け取り、文字や音声の出力につなげる用途が整理されています。

実務での考え方は単純で、「文章が中心ならResponses」「画像生成が中心ならImages系も検討」「既存のチャット実装で画像を入力したいだけならChat Completionsでも成立する場合がある」という整理になります。ただし、今後の推奨ルートはResponses寄りなので、長く使う前提ならResponses中心で組むほうが後で困りにくいです。

導入目的別のおすすめルート

導入は、いきなり本番にせず、段階を踏むほど失敗しにくいです。

学習段階では、ChatGPTで「どんな指示なら良い答えになるか」を先に見つけると早いです。PoC(小さな試作)では、その指示をResponses APIで呼び出して、入力と出力の形を決め、ログを残して、同じ条件で結果が出るかを確かめます。本番では、会話の持ち方(会話IDで持つのか、毎回送るのか)と、画像などの扱い、そして将来の変更に備える運用が大切になります。OpenAIはChat Completionsはサポート継続としつつ、新規はResponsesを推奨しています。

また、APIはモデルや機能が更新されるので、変更情報を追うことも現実的には重要です。たとえばOpenAIは、モデルの入れ替えやAPIの廃止予定などを「Deprecations(非推奨・終了予定)」として日付つきで公開しています。例として、特定モデルの廃止日(2026年2月17日など)や、Assistants APIが2026年8月26日に終了予定で、ResponsesとConversationsへの移行が案内されていることが書かれています。

まとめ

「ChatGPT」は完成したアプリで、「API」は自分の仕組みに組み込むための入口です。「ChatGPT API」という呼び方は昔の名残で、今はResponses APIが新しい中心で、Chat Completionsは古い方式として残っている、という整理がいちばん安全です。会話の状態は、短い作業なら毎回まとめて送り、長く続くなら会話IDで持つ設計にすると迷いにくくなります。画像などのマルチモーダルは、何をしたいか(見るのか、作るのか)でAPIの選び方が変わります。

ChatGPT API連携:種類(ツール/関数呼び出し)と連携パターン

ChatGPT APIを外部システムとつなぐと、「会話して終わり」ではなく「会話→実際の業務処理」まで一気に進められます。ポイントは、モデルに何でもやらせるのではなく、ツール(関数呼び出し)で“やってよい処理だけ”を安全に実行し、出力はJSONスキーマなどで形をそろえ、社内検索(RAG)で根拠つき回答を増やすことです。

ツール/関数呼び出しで「会話→業務処理」に変える

ツール呼び出しの仕組みが「モデルが勝手に操作する」のではなく、「モデルが“やりたい処理”を提案し、アプリ側が実行して結果を返す」という段取りになっているからです。OpenAIの案内では、この流れは大きく5つのステップ(ツール候補を渡す→ツール呼び出しを受け取る→アプリで実行→結果をモデルへ返す→最終回答)として整理されています。

問い合わせチャットで「注文状況を確認して」「返金条件を教えて」などが来たとき、モデルが「注文検索」や「規約検索」のツールを呼び出し、あなたのサーバーがDBを見て結果だけ返し、最後にモデルが“人にわかる文章”に整えて返す形です。こうした支援は実際の現場でも効果が報告されていて、カスタマーサポートで生成AI支援を入れると、1時間あたりに解決できる件数が約13.8%増えたという研究があります。

社内DB・CRM・在庫/予約など外部システム連携例

仕事の時間が「探すこと」に多く消えるからです。調査では、平均的な知識労働者が社内情報を探したり詳しい人を探したりするのに、仕事時間の“約20%”を使っているという推計があります。ここをAPI連携で短くできると、体感の効率が上がりやすいです。

社内DB・CRM・在庫/予約の連携は「人が画面を行ったり来たりして確認していたこと」を、会話の中で1回で済ませる方向に使います。たとえば、同じ問い合わせでも、連携がないと「担当に確認します」で止まりますが、連携があると「注文番号から状況を検索→在庫を確認→最短の配送候補を計算→返信文を作成」までを一続きにできます。下の表のように、まずは“読むだけ連携”から始めると安全です。

| 連携の型 | 何をするか | 安全に始めやすい理由 |

|---|---|---|

| 読む(参照) | 注文状況、顧客情報、在庫数、予約枠を取得 | 間違ってもデータを書き換えにくい |

| 書く(更新) | チケット起票、予約確定、在庫引当、メール送信 | 便利だが誤操作の影響が大きい |

| 書く前に確認 | 「この内容で実行していい?」を人に確認してから実行 | ミスを止めやすい |

この「読む→書く→確認つきで書く」の順で広げるのが、失敗しにくい進め方です。

構造化出力(JSONスキーマ等)で後段処理を安定化

文章のままだと後ろの処理(CSV保存、DB登録、通知)が壊れやすいからです。Structured Outputsは、指定したJSONスキーマに必ず従う形で出力させられる、と説明されています。つまり「必要な項目が抜ける」「想定外の値が混ざる」といった事故を減らす発想です。

問い合わせ文から「名前」「注文番号」「要望の種類」「緊急度」などを抜き出して、決まった箱(項目)に入れて返させ、そのままCSVやDBに流します。人が手でコピペして入力すると、どんなに注意してもミスが混ざりえます。実際、臨床研究のデータ処理方法をまとめたメタ分析では、単回入力の“プールされたエラー率”が0.29%、二重入力でも0.14%という数字が報告されています。小さく見えても件数が増えると効いてくるので、「最初から形をそろえる」設計が効きます。

検索連携(RAG)で社内ナレッジ回答を強化

モデルが“知っているつもり”で答えるより、社内資料を探して根拠を入れたほうが正確になりやすいからです。RAGの代表研究では、検索(外部知識)を組み合わせたモデルが、オープンドメインQAでスコアを上げています。たとえばNatural Questionsでは、DPRが41.5に対してRAG-Tokenが44.1といった結果が表に載っています。

社内規程・手順書・製品資料を“検索してから回答する”流れを作ります。OpenAIのResponses APIには、ファイル検索のツールが用意されていて、ベクターストアに入れた資料から関連部分を取り出し、回答の材料にする考え方が説明されています。さらに検索件数(取り出す数)を調整して、速さやコストと答えの質のバランスを取れる、とも書かれています。

連携時の落とし穴

連携すると便利になるぶん、事故の範囲も広がるからです。特に「権限(ログイン情報)」は重要で、VerizonのDBIRでは、資格情報の悪用が侵害の初期要因になった割合が22%とされ、また“基本的なWebアプリ攻撃”のパターンでは盗まれた認証情報が関わったものが約88%とされています。

次の3つを最初から入れると、後で困りにくいです。1つ目は権限を最小にすることです。たとえば「在庫は読めるが更新はできない」など、できる操作を狭くします。2つ目は誤操作を止めるために、重要操作は“人の確認”を挟むことです。3つ目はプロンプト注入(文章に混ぜた悪い指示で、モデルをだます攻撃)への備えです。OWASPはLLMアプリのTop 10で、プロンプト注入を最上位(LLM01)として扱っています。だから、モデルの出力をそのまま実行せず、「実行してよい操作の一覧(許可リスト)」「引数の検査」「危険操作は二重確認」をアプリ側で必ず行う設計が大切です。

被害の大きさという点でも、IBMのレポートではデータ侵害の世界平均コストが約488万ドルに達したとされています。連携は“便利な近道”ですが、同時に“危ない近道”にもなるので、権限と確認と監視をセットで考えるのが現実的です。

まとめ

ツール/関数呼び出しを使うと、モデルは「処理の提案役」、あなたのアプリは「実行役」になり、会話を業務処理につなげられます。外部システム連携は、社内情報を探す時間が大きいという現実(約20%)を減らす方向に効きやすいです。出力はJSONスキーマなどで形を固定すると、後段処理が壊れにくくなります。社内ナレッジはRAGで検索してから答える形にすると、QAベンチマークでも改善が報告されています。

ただし連携はリスクも広げます。資格情報の悪用が侵害の入口になりやすいこと、プロンプト注入が代表的な脅威として挙げられていることを前提に、最小権限・重要操作の確認・許可リストと検査・ログ監視までを最初から入れて進めるのが安全です。

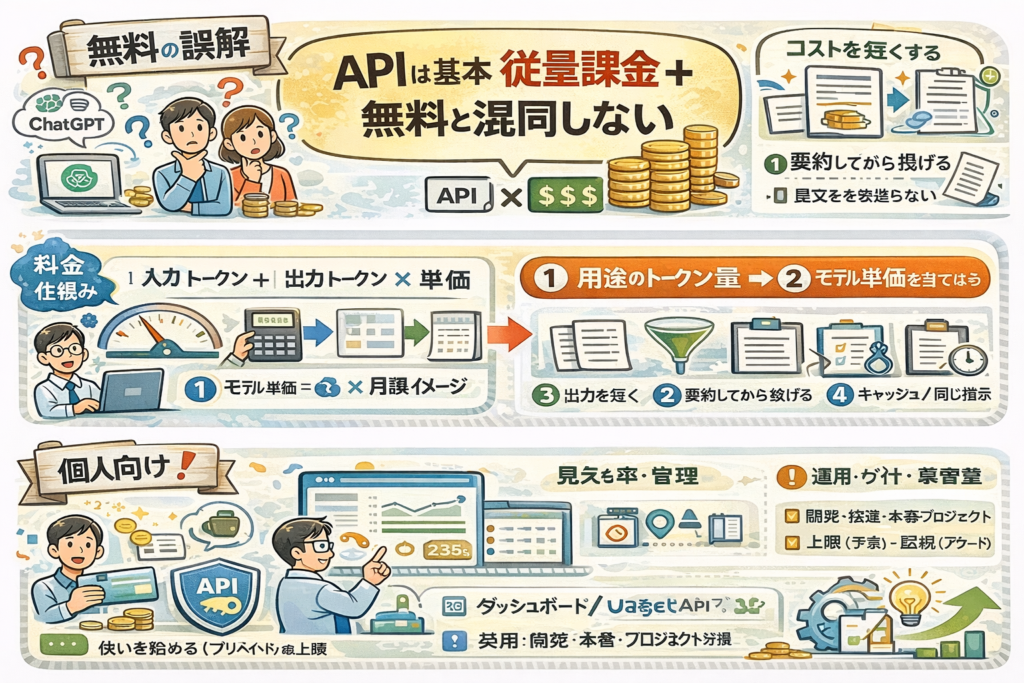

ChatGPTのAPIを活用するときの料金・無料・個人利用など

- ChatGPT API料金:仕組み(トークン)と料金目安

- ChatGPT API料金確認:使用量の見方・予算管理

- ChatGPT API無料枠・ChatGPT API 無料の誤解を整理

- ChatGPT API 使い方:個人利用でのおすすめワークフロー

- ChatGPT API アプリ:組み込みパターン(Web/モバイル)と注意点

ChatGPT API料金:仕組み(トークン)と料金目安

ChatGPT APIの料金は、「使った分だけ払う」従量課金が基本で、文章を送る量(入力トークン)と、返ってくる量(出力トークン)で決まります。料金を見積もるコツは、まず自分の用途で「だいたい何トークン使うか」を押さえ、次にモデルの単価(入力・出力・キャッシュ)を当てはめることです。うまく設計すると、同じ仕事でもトークンと課金を大きく減らせます。

従量課金の基本

ChatGPT APIは、文章をそのまま数えるのではなく「トークン」という単位で数えます。トークンは文字のかたまりで、英語だと目安として「1トークンは約4文字」「100トークンは約75語」などの目安が示されています。ただし言語によって増え方が変わり、英語以外は同じ文字数でもトークンが多くなることがあります。

料金は大きく「入力」「出力」「(条件を満たすと)キャッシュされた入力」に分かれ、出力トークンのほうが入力より高いモデルが多いです。さらにモデルごとに単価が違うので、同じ文量でもモデルが変わると料金が変わります。加えて、用途によっては処理の“速さのプラン”のような区分(標準より安いが遅い、標準、速いが高い)が用意されているため、同じモデルでも選ぶ区分で単価が変わる場合があります。

料金目安の出し方

見積もりはシンプルで、「入力トークン数×入力単価」+「出力トークン数×出力単価」で計算します。ポイントは、まず自分の用途で“だいたい何トークンか”を作っておくことです。英語なら「1〜2文で約30トークン、1段落で約100トークン」などの目安が公開されていますが、日本語は増え方が変わるので、最初は短い実データで測ってから見積もるとズレが減ります。

目安がつかめるように、例を2つだけ数字で置きます。たとえば短いメール下書きで、入力が500トークン、出力が300トークンだとします。もし単価が「入力は100万トークンあたり0.15ドル、出力は100万トークンあたり0.60ドル」のモデルなら、1回あたりは入力0.000075ドル+出力0.00018ドルで合計0.000255ドルくらいになります。同じ条件で月に1万回使うと、だいたい2.55ドルくらいです。

もう1つ、議事録の要約を考えます。入力が8,000トークン、出力が500トークンで同じ単価なら、1回あたり入力0.0012ドル+出力0.0003ドルで合計0.0015ドルくらいです。月に1,000回なら、だいたい1.5ドルくらいになります。もちろん実際には、モデル単価、返答の長さ、言語によるトークンの増え方で上下します。

モデル選定でコスト最適化

コスト最適化は「必要な品質に対して、いちばん安いモデルを当てる」が基本です。たとえば分類や短い整形は軽いモデルでも十分なことが多く、提案書のように“言い回しの質”が大事な仕事は上のモデルが必要になりやすい、という違いがあります。

単価の差がイメージできるように、代表的な例を表にします。ここでは標準の単価として、入力・キャッシュ入力・出力の100万トークンあたりの金額を並べています。

| モデル例(標準) | 入力($/100万) | キャッシュ入力($/100万) | 出力($/100万) |

|---|---|---|---|

| gpt-4o-mini | 0.15 | 0.075 | 0.60 |

| gpt-4.1-mini | 0.40 | 0.10 | 1.60 |

| gpt-5-mini | 0.25 | 0.025 | 2.00 |

| gpt-5.1 | 1.25 | 0.125 | 10.00 |

この表から分かる通り、「入力より出力が高い」モデルが多いので、返答を必要以上に長くしないだけでも効きます。また、同じモデルでも処理区分(安いが遅い、標準、速いが高い)を選べる場合があり、急ぎでない処理は安い区分や別の仕組みに寄せるとコストが落ちやすいです。

トークン削減テク

トークンを減らすと、そのまま料金が下がりやすいです。よく効くのは「毎回同じ長い説明を送らない」「長い資料をそのまま投げず、先に短くしてから使う」「返答の形を決めて、余計な文章を出させない」という考え方です。

要約は分かりやすい例です。会話や資料が長くなると入力トークンが増え続けるので、途中で“ここまでの要点”を短くまとめて、それ以降は要点だけを渡すようにすると、入力が減って安くなります。指示短縮も同じで、毎回同じルールを長文で送る代わりに、社内で「短い合言葉(ID)」にして、サーバー側で展開して送るようにすると、入力が小さくなります。

構造化は、返答のムダを減らすのに効きます。たとえば議事録なら「決まったこと」「宿題」「期限」「担当」だけが欲しいのに、文章で長く説明されると出力が増えます。最初から「この項目だけを埋めて返して」と形を決めると、返答が短くなり、後の処理もやりやすくなります。

キャッシュ/再利用で課金を減らす発想

課金を減らす“再利用”には2種類あります。1つ目は、OpenAI側の仕組みとして、同じ内容がくり返し送られる場合に、入力トークンの一部が「キャッシュされた入力」として安くなる考え方です。公式には、プロンプトキャッシュが自動で働き、遅さ(待ち時間)を最大80%減らし、入力トークンのコストを最大90%減らせる、と説明されています。つまり、同じ長い前置き(ルールや定型の説明)を毎回使う仕事ほど、効きやすいです。

2つ目は、あなたの側での再利用です。たとえば「同じ質問が何度も来る」「同じ条件で同じ文章を作る」なら、前に作った結果を保存しておき、まったく同じ条件ならAPIを呼ばずに返すだけで、その分の課金がゼロになります。

さらに、時間が急ぎでない大量処理なら、まとめて投げる仕組み(バッチ)で、通常より安くなると案内されています。結果がすぐ返らなくてよいバックオフィス処理は、こうした仕組みに寄せるとコストが落ちやすいです。

まとめ

ChatGPT APIの料金はトークンで決まり、入力と出力、そして条件を満たすと安くなるキャッシュ入力に分かれます。見積もりは「入力×単価+出力×単価」で出せるので、まず自分の用途のトークン量を小さく測ってから、モデルの単価を当てはめるとズレが減ります。

コスト最適化は、必要な品質に合うモデル選びと、出力を短くする工夫が中心です。加えて、要約・指示短縮・構造化でトークンを減らし、キャッシュや再利用、時間が急ぎでない処理の割引仕組みを組み合わせると、料金が下がりやすくなります。

ChatGPT API料金確認:使用量の見方・予算管理

ChatGPT APIの料金確認と予算管理は、「どこで使ったか」を見える化して、「どこまで使ってよいか」を先に決めるだけで、かなり安定します。OpenAIには利用状況を確認するダッシュボードと、利用量・費用を取り出せるUsage APIとCosts APIがあり、特に請求と一致させたいときはCosts側を見るのが基本です。

そして世の中では、クラウド費用の管理に苦労している会社が多く、調査では「クラウド支出の管理が最大の課題」と答えた割合が84%で、無駄なクラウド支出が27%続いている、という示し方もされています。だからこそ、最初から「開発・検証・本番」で分けて、上限とアラートと配賦の形を作るのが近道です。

どこで利用状況を確認するか

まずは「見る場所」を1つに決めるのが大事です。OpenAIの新しいUsage Dashboardは、組織オーナーが見られる設計で、表示のタイムゾーンはUTCです。つまり日本時間(JST)で見たい場合は、日付のズレが起きやすい前提でチェックします。

また、請求と数字を合わせたいときは、Usage APIの説明でも「Costs endpoint」またはダッシュボードのCostsタブを使うのが推奨されています。Usage(利用量)とCosts(費用)は、記録のされ方の違いで少しズレることがある、と明記されているためです。

古い(レガシー)ダッシュボードでは、CostとActivityの2ビューがあり、エクスポートは最大60日分で、反映の遅れが起きることがある、と説明されています。

新しいダッシュボード側は、エクスポートの期間制限は特に設けない一方で、長い期間を指定すると複数ファイルに分割される場合がある、と案内されています。

用途別に「どれを見るか」を表にすると、こう整理できます。

| 見るもの | 何がわかるか | 使いどころ |

|---|---|---|

| Usage Dashboard(費用) | 請求に近い費用の見え方 | 月末の精算、部門への説明、請求チェック |

| Usage Dashboard(利用量) | どの機能・モデル・ユーザーで使ったか | 急な増加の原因探し、最適化ポイント探し |

| Usage API / Costs API | 利用量・費用を機械的に取得できる | 社内BIに取り込む、アラートや監視の自動化 |

プロジェクト/環境別(開発・検証・本番)の分け方

予算管理をラクにする最短ルートは、「環境ごとにプロジェクトを分ける」ことです。OpenAIのProjects機能は、アクセス制御、モデルの利用範囲、レート制限、予算(プロジェクト予算)などをプロジェクト単位で扱える、と説明されています。

さらに、組織は最大1000プロジェクトまで作れるので、開発・検証・本番を分けても“枠が足りない”になりにくい設計です。

加えて、サブ組織をたくさん作ってしまうと、Usage Dashboardで組織をまたいだ集計ができないため、まとめて見たいなら「サブ組織からプロジェクトへ移す」か「Usage APIで集計する」という考え方が示されています。

運用のイメージを、短く表にします。

| 環境 | ねらい | 設計のコツ |

|---|---|---|

| 開発 | 早く試す | 低めの予算、軽いモデル中心、テスト用の鍵を分離 |

| 検証 | 本番に近い形で確認 | 本番と同じログ設計、想定ユーザー数で負荷テスト |

| 本番 | 安定運用 | 権限を絞ったサービスアカウント、厳しめの監視とアラート |

請求トラブルを防ぐ運用

請求トラブルは「気づくのが遅い」ほど痛くなります。情報セキュリティの分野でも、侵害を見つけるまで平均194日、封じ込めまで平均64日かかる、というデータが示されていて、監視と早期検知がどれだけ重要かが数字で出ています。

費用面でも、無駄なクラウド支出が27%続いている、という示し方があるので、使いすぎを“翌月に気づく”のでは遅い、という発想になります。

OpenAI側の手段としては、プロジェクト予算や、利用状況をプログラムで取れるUsage APIとCosts APIが用意されています。レガシーの説明でも「APIをポーリングしてアラートを設定する」用途が書かれています。

また、APIキーのトラッキングは重要で、2023年12月20日以降に作成されたキーは追跡がデフォルトで有効で、それ以前のキーは追跡を有効化する必要がある、という注意が明記されています。

ここまでを前提にすると、請求トラブルを防ぐ現実的な形は「上限(予算)+日次で増分チェック+異常時通知」の3点セットになります。

部署/機能別にコストを配賦する設計

部署別・機能別にコストを割り振れないと、「どこが増えたのか」が分からず、改善も止まりがちです。ところが、外部調査の紹介では、クラウド費用を“単位(ユニット)レベル”で追えている組織は43%にとどまる、という話が出ています。つまり、配賦は多くの会社でつまずきやすいポイントです。

OpenAI側では、Costs endpointがプロジェクトIDでの内訳に対応し、Usage APIもproject_idやuser_id、api_key_idなどでグルーピングできる、と説明されています。これを使うと「部署=プロジェクト」「機能=APIキー」という分け方がやりやすくなります。

さらにレガシーの説明でも、機能・チーム・プロダクト・プロジェクトごとにAPIキーを分けると確認しやすい、と書かれています。

配賦の“最小で回る形”を表にすると、こうなります。

| 何で分けたいか | どう分けるか | 後で集計する軸 |

|---|---|---|

| 部署 | 部署ごとにプロジェクトを作る | project_id(費用と請求に近い) |

| 機能(例:要約、返信、検索) | 機能ごとにAPIキーを作る | api_key_id(原因特定が速い) |

| 利用者 | ユーザーごとに識別子を持つ | user_id(社内の責任分界が明確) |

ログとメトリクス(コスト×品質)をセットで見る

コストだけ見ていると、「安いけどミスが多い」「品質が悪くて結局やり直し」という落とし穴に入ります。実際、データ処理の研究では、単回の手入力でもエラー率が0.29%という推計が示されていて、少しのミスでも件数が増えると効いてきます。

だから、コストと一緒に「品質の指標」もセットで見るのが安全です。

最小セットとしては、コストはCosts側で日次・月次、品質は「再実行率」「人の修正量」「エラー率」のような“結果”を押さえます。さらに、異常検知の重要性は、侵害検知に平均194日かかるというデータが示す通り、ログがないと原因追跡が長引く、という形で表れます。

たとえば、ログとメトリクスを次の表の範囲で持つだけでも、「安いのに遅い」「速いのに高い」「高いのに直しが多い」が見えるようになります。

| 見る項目 | 例 | 何がわかるか |

|---|---|---|

| コスト | 日次費用、モデル別費用、プロジェクト別費用 | 増加の場所とタイミング |

| 量 | 入力トークン、出力トークン、呼び出し回数 | 料金の増え方の原因 |

| 速さ | 応答時間、タイムアウト回数 | 体感の悪化や障害の兆候 |

| 品質 | 人の修正回数、再生成回数、誤抽出率 | “やり直しコスト”の把握 |

| 監視 | 予算到達の予兆、急増アラート | 早期に止める仕組み |

まとめ

ChatGPT APIの料金確認は、ダッシュボードで日々の変化を見つつ、請求と整合させたいときはCosts側を見るのが基本です。表示はUTCなので、日本時間とのズレも前提にして確認します。

予算管理は、開発・検証・本番をプロジェクトで分け、キーの追跡を有効にし、Usage APIとCosts APIで監視とアラートまで自動化すると安定します。

配賦は「部署=プロジェクト」「機能=APIキー」で最小構成が作れ、Usage APIのグルーピング軸がそのまま役に立ちます。

最後に、コストだけでなく品質も一緒に見ないと、やり直しで結局高くなるので、ログとメトリクスは最初からセットで持つのが安全です。

ChatGPT API無料枠・ChatGPT API 無料の誤解を整理

「ChatGPT APIは無料で使える」と聞くことがありますが、いま多い現実は「ChatGPT(画面で使うほう)は無料プランがある。一方で、API(自分のアプリに組み込むほう)は基本的に使った分だけ支払う」です。さらに、ChatGPTの有料プラン(Plus/Proなど)に入っても、API料金が自動で無料になるわけではありません。

「無料で使う方法」はゼロ円にこだわるより、失敗しない範囲で“ほぼ無料に近い出費”に抑えるのがコツです。たとえば、まずは小さなテストだけ行い、課金が暴走しない仕組み(キー管理・上限・監視)を先に作ると安心です。

「無料」と言われるケースの内訳

まず混ざりやすいのが「ChatGPTの無料」と「APIの無料」です。ChatGPTには無料プランがあり、一定の回数制限の中で使える、と案内されています。

一方、ChatGPT Plus/Proの説明では「API利用は別で、別料金」とはっきり書かれています。つまり「ChatGPTが無料(またはサブスクで使える)」ことと「APIが無料」は別物です。

次に多いのが「無料トライアル=APIも無料」という誤解です。無料トライアルの案内は、基本的にChatGPTのサブスク(一定期間だけ無料)に関する話です。

さらに「昔はAPIに無料クレジットが付いた」という古い記事が残っていて混乱しがちですが、少なくとも2024年時点でも「付与されない」相談がコミュニティで多数出ています。

整理すると、こんな感じです。

| 「無料」と言われがちなもの | 実際に無料になりやすい範囲 | 気をつける点 |

|---|---|---|

| ChatGPTの無料プラン | ChatGPT内の利用(回数制限あり) | APIの料金とは別 |

| ChatGPTの無料トライアル | ChatGPTサブスクの一定期間 | APIクレジットとは別 |

| 「APIも無料で試せる」系の古い情報 | いまの条件とズレていることがある | 付与されない例が多い |

無料に近づける代替案

ゼロ円にこだわるより、まず「小さく始める」が安全です。OpenAIの案内では、APIはプリペイド(先に使う分を買う)という考え方があり、新しいアカウントはプリペイドに入る、と説明されています。これなら「先に決めた範囲でしか使えない」ので、予算を守りやすいです。

また、APIを触る前に、ChatGPT無料プランで「プロンプト(指示)の形」だけ作り、うまくいったらAPIに持っていくと、APIでの試行回数を減らせます。ChatGPT無料プランには回数制限がある前提ですが、試作の場としては十分役に立ちます。

さらに、同じ指示文を何度も使う仕事なら、プロンプトキャッシュが効いて入力コストを下げやすいです。公式ガイドでは、プロンプトキャッシュで入力コストを最大90%減らせる、と説明されています。

失敗しない課金対策

課金トラブルの原因で多いのは、キーが漏れて勝手に使われる、またはプログラムのミスで大量に呼び出してしまう、の2つです。

キー漏洩については、OpenAIが「ブラウザやスマホなど“利用者の端末側”にAPIキーを置かない」「必ず自分のサーバー側で呼び出す」などの注意を出しています。これを守るだけで事故が減ります。

また、キーは環境変数で管理するなど、基本の守り方も案内されています。

暴走リクエストについては、エラーコードの説明がヒントになります。たとえば429(送信しすぎ)や「quota超え」は、無料や低い利用枠だと起きやすい、と書かれています。つまり、最初から「1分に何回まで」「同時に何本まで」をアプリ側で制限し、失敗したら少し待つ、という仕組みを入れるのが大事です。

もし身に覚えのない請求が出たときの手順も案内されています。

PoCでやるべき最小検証

PoC(小さな試作)で大事なのは、「無料かどうか」より「この仕事が本当に安く・速く・よくなるか」を数字で確かめることです。

最小の検証は、同じ作業を「人だけでやる場合」と「APIで下書きを作って人が直す場合」で比べることです。比べる数字は、作業時間と、APIの入力・出力の量(トークン)と、やり直し回数です。これをやると「安いモデルで足りるのか」「返事を短くすべきか」が見えます。

また、同じ定型指示を何回も使うなら、キャッシュが効くように“同じ文章を先頭に置く”のがコツだと説明されています。PoCの段階でここまで設計すると、本番で料金が跳ねにくいです。

個人利用での現実的な運用ルール

個人利用では「月いくらまで」と「1日何回まで」を先に決めると、気持ちが楽になります。新しいアカウントはプリペイドという説明があるので、まずは小さな金額だけ入れて、そこで止まるようにしておくのが安全です。

そして、使い方のルールはシンプルで十分です。たとえば、長文をそのまま毎回投げずに、先に短くしてから投げる。毎回同じ長い説明を送らない。よく使う定型指示はキャッシュが効くように同じ形で先頭に置く。こうした工夫は、公式に「入力コストを最大90%減らせる場合がある」と説明されているので、個人でも効きやすいです。

まとめ

ChatGPTの無料プランや無料トライアルは「ChatGPT(画面で使うほう)」の話で、APIが自動で無料になる話とは別です。Plus/Proなどのサブスクでも、API利用は別料金です。

無料に近づけるなら、ChatGPTでプロンプトを試してからAPIに持っていく、プリペイドで小さく始める、キャッシュが効く形にして入力コストを下げる、の順が安全です。課金の事故を防ぐには、キーを端末側に置かないことと、呼び出し回数の制限をアプリ側で入れることが基本です。

ChatGPT API 使い方:個人利用でのおすすめワークフロー

個人でChatGPT APIをうまく使うコツは、「まず1つの用途だけにしぼって成功体験を作ること」と、「入力の形(テンプレ)と、出力のチェック(検証)を先に決めること」です。研究でも、文章タスクでAIを使うと作業時間が大きく短くなり、出来上がりの質も上がる結果が出ています[1]。ただし、出力をそのまま信じるのは危険で、実際に「AIの正確さを信じにくい」と答える人が多い調査結果もあります[2]。だからこそ、ワークフローとして“安全に回る形”を作るのが近道です。

まずは「1用途固定」で成功体験を作る

最初にやるべきなのは、「要約」などの1用途だけに固定することです。理由は、AIは“なんでも屋”にすると失敗が増えやすいからです。文章タスクでは、AI利用で時間が約40%短くなり、質が約18%上がったという研究結果があります[1]。この効果を取りに行くには、仕事を小さく切って「同じ型」で回すのがいちばん簡単です。

たとえば要約なら、次のように“最小の勝ちパターン”を作れます。

| 手順 | やること | ゴール |

|---|---|---|

| 1 | 要約したい文章を用意する(議事録、記事、メモなど) | 入力を決める |

| 2 | 出力の長さを固定する(例:200字、3段落など) | ぶれを減らす |

| 3 | 出力チェックをする(数字、固有名詞、結論のズレ) | 事故を減らす |

| 4 | うまくいった文章だけ保存して再利用する | 成功を積み上げる |

テンプレ化(入力フォーマット固定)で再現性を上げる

入力のテンプレを固定すると、出力のばらつきが減り、作業が安定します。さらに、テンプレを毎回同じ形で使うと、プロンプトキャッシュが効いて、入力コストを最大90%減らし、待ち時間も最大80%減らせると説明されています[3]。つまりテンプレ化は、再現性だけでなく、速さと料金にも効く可能性があります。

個人利用なら、まず次の“4箱テンプレ”で十分です。

| 箱 | 書く内容の例 |

|---|---|

| 目的 | 何をしたいか(例:200字で要約) |

| 元の文章 | 要約したい本文 |

| 条件 | やさしい言葉、専門用語は説明、数字はそのまま |

| 出力形式 | 見出しの有無、段落数、表の可否 |

テンプレを作ったら、同じ形のまま少しずつ良くしていきます。テンプレの形が毎回変わると、どこが効いたのか分からなくなり、改善が続きません。

出力検証の最低ライン

出力検証は「最低ライン」だけ決めれば、個人でも回ります。なぜなら、AIの出力を“そのまま正しい”と見なす人は多くなく、調査ではAIの正確さを「信じない」と答えた割合が「信じる」を上回ったという結果があります[2]。だから、チェック前提で使うのが現実的です。

最低ラインのチェックは、次の表の範囲で十分です。

| チェック項目 | 見るポイント | よくあるNG |

|---|---|---|

| 数字 | 日付、金額、回数、割合が元文と一致 | 数字が変わる、単位が抜ける |

| 固有名詞 | 人名、会社名、製品名が元文と一致 | 似た名前に置き換わる |

| 事実と意見 | どこまでが事実で、どこからが推測か | 推測を事実っぽく書く |

| 禁止事項 | 書かないと決めたことが混ざっていない | 個人情報、内部情報が混ざる |

| 形式 | 指定した長さ・段落・項目に合う | 長すぎる、項目が欠ける |

NG例のイメージとしては、「元文にない“原因”や“気持ち”を勝手に足してしまう」「元文にない数字を出してしまう」「要約なのに結論が逆になる」などです。ここを1分でも目視すると、失敗がぐっと減ります。

個人情報を入れないためのルール化

個人利用で一番ラクに安全を上げる方法は、「そもそも個人情報を入れない」ルールを作ることです。NIST(米国の公的機関)も、個人を特定できる情報は不適切なアクセスや利用、開示から守るべきだとガイドで示しています[4]。

また、OpenAIのAPIでは、入力と出力が不正利用対策のために最大30日保持されうる、と説明されています[5]。さらに、APIに送ったデータは原則として学習に使われない(明示的に同意しない限り)という説明もあります[6]。この前提でも、個人情報を入れないのがいちばん安全で、運用も簡単です。

個人のルールは難しくしなくて大丈夫です。たとえば「名前・住所・電話・メール・社員番号・注文番号・顔写真・位置情報は入れない」「どうしても必要なら、伏せ字にして意味が通る形に変える」と決めるだけで、事故が減ります。

小規模でも回るプロンプト管理

個人利用でも、プロンプトは“道具”なので、置き場所と版(バージョン)を決めると迷子になりません。現実に、多くの人が日常的に版管理の仕組み(Git)を使っているという調査結果もあります[7]。つまり「書いたら保存して、いつでも戻せる」形は、特別なことではありません。

小規模なら、次の考え方だけで回ります。テンプレは1ファイルにまとめ、日付と目的で名前を付け、変更したら「何を変えたか」を1行メモします。もしチームで共有するなら、OpenAIの仕組みとして、プロンプトを“長く使える部品”として管理し、バージョンを付けたり、変数を入れたりできる説明もあります[8]。こうすると「どの版が一番よかったか」を後で比べやすくなります。

まとめ

個人でChatGPT APIを使うなら、最初は「要約」など1用途に固定し、テンプレを作って同じ形で回すのが成功しやすいです。テンプレ化は、出力のぶれを減らすだけでなく、仕組み次第で待ち時間や料金の面でも得になりえます[3]。

ただし、出力はそのまま信じず、数字と固有名詞だけでもチェックするのが安全です[2]。個人情報は入れないルールを作り、プロンプトは版管理して改善を積み上げると、少ない手間で安定して使えるようになります[4][5][8]。

ChatGPT API アプリ:組み込みパターン(Web/モバイル)と注意点

WebやモバイルにChatGPT APIを組み込むときは、「アプリから直接APIを呼ばない」「自分のバックエンドを通す」「通信が遅い・混む・落ちる前提で作る」の3つで成功しやすくなります。とくにAPIキーは“家のカギ”なので、ブラウザやアプリの中に入れてしまうと抜かれて悪用されやすい、と公式に注意されています。

クライアント直叩きを避ける

ブラウザやスマホアプリは、利用者の手元にあるので「中身をのぞかれる前提」で考える必要があります。だから、APIキーをクライアント側(ブラウザ・モバイル)に置かないのが大原則です。公式ドキュメントでも「クライアント側にキーを置かない」「バックエンド経由にする」と明確に書かれています。

ここを守るだけで、勝手に使われて料金が増える事故を大きく減らせます。さらにバックエンドに寄せると、「この人は使ってよいか」「1分に何回までか」「長すぎる入力は止める」など、入口でコントロールできます。

バックエンド経由の基本アーキテクチャ

基本は「クライアント→自分のサーバー→OpenAI→自分のサーバー→クライアント」です。サーバーがAPIキーを持ち、クライアントは“自分のサーバー”にだけ話しかけます。これで、キーが守れるだけでなく、ログ・課金管理・安全対策も入れやすくなります。

設計の役割分担を、ざっくり表にするとこうなります。

| どこ | 主な役目 | なぜ大事か |

|---|---|---|

| クライアント(Web/モバイル) | 入力して表示する、キャンセルする | 速く見せる工夫がしやすい |

| バックエンド | 認証、回数制限、API呼び出し、ログ、危険操作のブレーキ | キーを守り、事故を止められる |

| OpenAI API | 文章生成、要約、抽出、ツール呼び出し | 生成の本体 |

ストリーミングUIの実装ポイント

ストリーミングは「答えが全部できてから表示」ではなく、「できた分から少しずつ表示」するやり方です。公式ガイドでも、長い出力は待ち時間が増えるので、ストリーミングで先に表示できると説明されています。

人の感覚としても、0.1秒は“すぐ反応した”と感じやすく、1秒は“考えが途切れにくい”目安だと言われています。だから、まず最初の文字が早く出るだけでも体感が良くなります。

実装の考え方は難しくなくて、「サーバーが受け取ったストリームを、そのままクライアントへ流す」形が分かりやすいです。途中でユーザーが止めたら(キャンセルしたら)、クライアントは表示を止め、サーバー側も接続を閉じるようにして“無駄に出力を作り続けない”設計にすると、体感とコストの両方に効きます。

レート制限・タイムアウト・リトライ設計

混んでいるときや短時間に呼びすぎたときは、レート制限(429)になりえます。公式ガイドでは、429対策として「無理に連打しない」「指数バックオフ(少し待って、だめならもっと待つ)」「ランダムなゆらぎ(同時再試行の衝突を減らす)」がすすめられています。

タイムアウトも“いつか起きるもの”として扱うのが安全です。公式ガイドでは、公式SDKのデフォルトタイムアウトが10分で、必要に応じて設定を変えられると説明されています。

まとめると、現実的に効くのは「入口で回数制限」「429はバックオフで再試行」「5xxは少し待って数回だけ再試行」「タイムアウトはやり直し用の道を用意」の4つです。エラーコードのガイドでも、レート制限やサーバー側エラーでは待ってリトライし、状況によってはステータス情報も確認するよう案内されています。

障害時のフォールバック

どんな外部サービスでも、調子が悪い時間はゼロになりません。公式のエラー案内でも、サーバー側エラーが出たら「少し待って再試行」「状況確認」といった行動が示されています。

だからアプリ側は、落ちたときの“逃げ道”を用意しておくと安心です。たとえば、返事が作れないときは短いテンプレ文を返して「受け取りました。少し時間をください」と伝え、裏で再試行する形にします。社内向けなら、失敗したケースを一覧にして人が処理できるように切り替えるだけでも、ユーザー体験が崩れにくくなります。

もう一つ大事なのが、安全の事故を広げないことです。外部システム連携やツール実行があるアプリでは、攻撃者が文章に“悪い指示”を混ぜて動かそうとする「プロンプト注入」が問題になります。OWASPでも代表的なリスクとして整理されています。だから「できる操作を最小にする」「危険操作は確認を入れる」「モデルの出力をそのまま実行しない」というブレーキを、フォールバックと同じくらい最初から入れるのが安全です。

まとめ

Web/モバイルに組み込むときは、まずクライアント直叩きをやめてバックエンド経由にし、APIキーを守るのが第一です。

次に、ストリーミングで“待っている感じ”を減らすと体感が上がりやすく、0.1秒と1秒の目安も考えるとUIが作りやすくなります。

最後に、レート制限やタイムアウトは必ず起きる前提で、バックオフ・リトライ・上限・フォールバック(テンプレ返信や人手切替)まで用意しておくと、アプリが安定します。

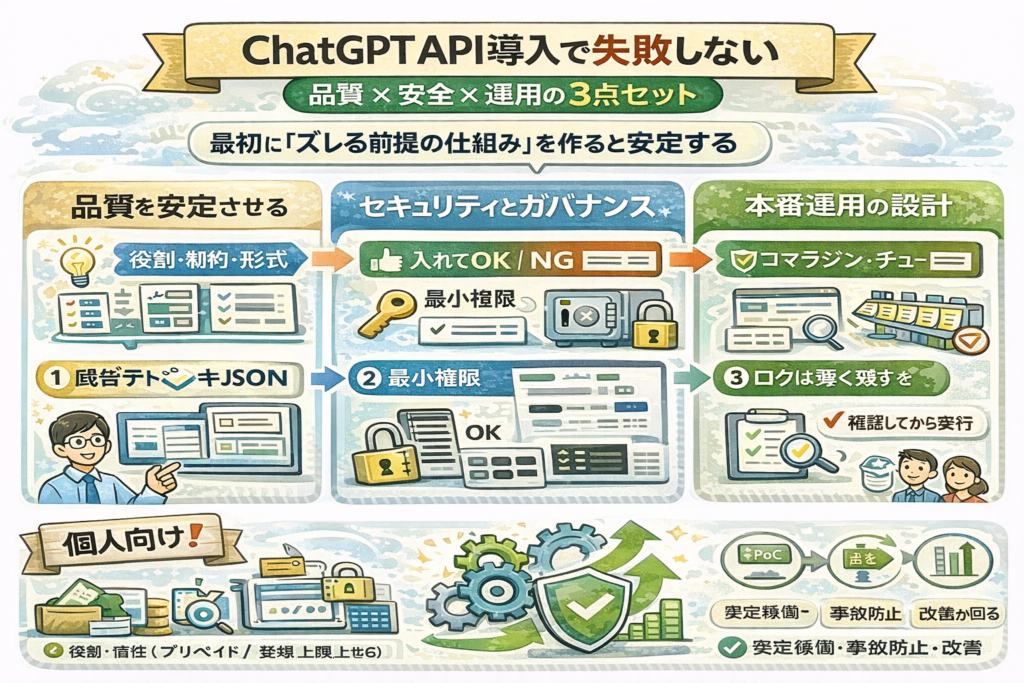

ChatGPTのAPI導入で失敗しないための補足

- 品質を安定させる

- セキュリティとガバナンス

- 本番運用の設計

品質を安定させる

ChatGPT APIの出力品質を安定させるコツは、プロンプトを「役割・制約・出力形式」で整えて、危ない動きを止める“安全の柵(ガードレール)”を置き、テストで毎回同じ確認をすることです。生成AIのリスクは、起きるかどうかが場面で変わり、不確実なものもあると整理されています。だから「うまくいくはず」ではなく、「ズレる前提で見張る」設計がいちばん効きます。

プロンプト設計の基本

まず効くのは、モデルに「あなたは何者で、何を成功とするか」を最初に伝えることです。OpenAIのガイドでも、良い結果を安定して出すために、はっきりした指示を書いて、情報と指示を区切って渡す考え方が説明されています。

同じ仕事を毎回同じ形で渡します。たとえば「あなたは要約係」「守るルール(短く、数字は変えない)」「出力の形(見出しと本文の順)」を固定すると、返答のブレが小さくなります。ここで大事なのは、制約を増やしすぎないことです。制約が多すぎると、かえって読みにくい返答になったり、守るべき順番が崩れたりします。だから最初は、役割、禁止事項、出力形式の3つにしぼるのが安全です。

構造化出力でブレを減らす

文章だけで返すと、後の処理が不安定になります。たとえば「担当」「期限」「分類」の3つが欲しいのに、文章で長く説明されると、読み取りミスが起きやすいです。そこで役に立つのが構造化出力です。OpenAIは、JSONスキーマ(項目と型を決めたルール)を渡すことで、モデルの出力をその形に必ず合わせる仕組みを説明しています。

問い合わせを処理するなら「カテゴリ」「緊急度」「次の担当部署」だけをJSONで返させます。こうすると、後段のCSV保存やDB登録が安定し、余計な言い回しの差で壊れにくくなります。

幻覚対策

幻覚対策は「根拠を出せ」と言うだけでは足りません。そもそも生成AIのリスクは、確実に起きるものだけでなく、不確実なものも混ざると整理されています。だから、答えがあいまいになりやすい質問では「不明なら不明と言う」「追加で必要な情報を聞く」という動きを、最初からルールに入れるのが現実的です。

社内データが必要な質問に対して、モデル単体で答えさせません。社内の参照データを渡すか、検索で拾った情報だけで答えるルールにします。さらに「根拠が本文にないなら推測を書かない」と明記して、推測は推測として分けて書かせます。

加えて、ガードレールの観点では、プロンプト注入(入力文に悪い指示を混ぜて動かす攻撃)が大きな問題になります。OWASPはLLMアプリのリスクでプロンプト注入を最上位に置いています。英国のNCSCも、プロンプト注入は仕組みの性質上やっかいで、残るリスクを前提に被害を小さくする設計が必要だと述べています。だから、モデルの出力をそのまま実行せず、実行してよい操作を決めて、入力や引数を必ず検査するのが基本になります。

評価指標と回帰テスト

品質を安定させるには、「良い返答」の例を先に集めて、同じテストを何度も回すのが近道です。OpenAIは、評価(Evals)でテストデータと基準を用意し、評価実行を作って結果を見る流れを説明しています。数で点数化する評価は、回帰テスト(変更で悪くなっていないかのチェック)に使える、とも整理されています。

まず「期待回答セット」を30〜100個くらい作ります。中身は、よく出る入力と、理想の出力、そして合格条件です。合格条件は、たとえば「JSONが壊れていない割合」「カテゴリが合っている割合」「禁止語が出ていない割合」のように、数字で見える形にします。こうしておくと、プロンプトやモデルを変えたときに、どこが良くなってどこが悪くなったかがすぐ分かります。

表にすると、テストの見え方はこうなります。

| 目的 | 指標の例 | 合格の考え方の例 |

|---|---|---|

| 形式を守る | JSONが正しい割合 | ほぼ100%を目標にする |

| 内容を当てる | 分類の正解率、抽出の一致率 | 重要項目ほど高くする |

| 安全を守る | 禁止事項の混入率 | 0%を目標にする |

プロンプト/設定のバージョニング

最後に効くのが「いつ、何を変えたか」を残すことです。OpenAIのガイドでは、ダッシュボード上でプロンプトを作って保存し、バージョン管理して共有できる考え方が説明されています。さらに、公開するたびに評価を回して問題を早めに見つける、という運用の考え方も示されています。

プロンプトと設定に番号を付けます。たとえば「1.2」のように、小さな修正は小数点以下を上げ、ルールを大きく変えたら先頭の数字を上げます。これはNISTの文書でも、版(バージョン)を二段の番号で管理する考え方が説明されています。こうすると、どの版で成績が良かったかを後で追いやすくなります。

まとめ

品質を安定させるには、プロンプトを「役割・制約・出力形式」でシンプルに固定し、構造化出力で形をそろえ、あいまいな場面では「不明と言う」「追加情報を聞く」をルールに入れるのが効きます。

さらに、評価データを作って回帰テストを回し、プロンプトや設定をバージョン管理して、変更のたびに品質が落ちていないかを確認すると、長く安定して運用できます。

セキュリティとガバナンス

ChatGPT APIを安全に使うには、「入れてよい情報を決める」「権限をしぼる」「ログを残す」「社内ルールで守る」「外部連携(ツール呼び出し)を“安全に止まれる形”にする」の5つを先に固めるのが近道です。

特にAPIキーや機密情報の扱いをあいまいにすると、想定外の課金や情報漏えいにつながりやすいです。実際、GitHub上で検出された“秘密情報(キーなど)”は約369万件という報告があり、増加傾向です。 また、侵害の入口として「盗まれた認証情報」が使われた割合が22%という調査結果もあります。

個人情報・機密情報を扱う前に決めること

まず決めるべきは「何を送ってよいか」です。公的ガイドでも、個人を特定できる情報(PII)は、不適切なアクセス・利用・開示から守る必要があると整理されています。

さらに、APIに送った内容が“どう扱われるか”の前提も押さえておくと、ルールを作りやすくなります。OpenAIの説明では、API利用では不正利用対策のログ(abuse monitoring logs)が作られ、原則として最大30日保持される可能性があります。 そして、条件により「Modified Abuse Monitoring」や「Zero Data Retention(承認制)」のように、ログへ入る内容を減らす選択肢があることも書かれています。

個人情報・機密情報の扱いは、難しくしすぎずに、最低限これだけ決めると回ります。

| 決めること | 例 | ねらい |

|---|---|---|

| 入れてよい情報/ダメな情報 | 氏名・住所・社員番号・契約番号は入れない、必要なら伏せ字にする | そもそも漏らさない |

| 利用目的 | “要約だけ” “分類だけ” のように用途を固定する | 送る情報を最小にする |

| 保管の方針 | 出力を保存するなら、保存先・期間・閲覧者を決める | いつまでも残さない |

| データの前処理 | IDを別の記号に置き換える、不要な行を削る | 送る量もリスクも下げる |

APIキーと権限

APIキーは“家のカギ”です。OpenAIは、キーをブラウザやモバイルなどのクライアント側に置かないこと、チームでキーを共有しないこと、リポジトリにコミットしないことを明確に注意しています。

ここでのポイントは「最小権限」です。OpenAIにはRBAC(役割ベースの権限管理)があり、組織・プロジェクト単位で権限をしぼったり、必要な権限だけのカスタムロールを作れると説明されています。 また、プロジェクトには“人にひもづかない”サービスアカウント(botユーザー)を作れるため、担当者が退職したときに運用が止まりにくくなります。

ローテーション(定期的な差し替え)も大切です。OpenAIのガイドでも、漏えいが疑われる場合はすぐにキーを回転(再発行・差し替え)することが書かれています。 そもそも漏えいは珍しくなく、GitHubでの秘密情報検出が約369万件という数字が「事故は起きる前提」を支えます。

ログ設計

ログは「困ったときに戻れる」ための保険です。NISTのログ管理ガイドでは、ログの生成・保護・保管・レビューなどを含む運用の重要性が整理されています。

また、被害が起きたときに気づくのが遅いほど損が大きくなりやすいです。IBMの報告では、平均で侵害の特定に194日、封じ込めに64日かかったという数字が示されています。 だから「ログは最初から薄くても良いので残す」が現実的です。

個人情報を含む可能性があるので、ログは“全文保存”より“必要最小限+マスキング”が安全です。NISTはPII保護の考え方を示しており、ログにも同じ発想が使えます。

| ログに残す | 残し方の例 | 残さない(マスクする) |

|---|---|---|

| 追跡に必要 | 時刻、プロジェクトID、APIキーID、モデル名、処理名、入力/出力の長さ | APIキーの値、氏名、住所、メール、社員番号 |

| 品質に必要 | エラーコード、再試行回数、遅延時間、出力が形式に合ったか | 入力本文の全文(必要なら要約やハッシュ) |

| 監査に必要 | “誰が設定を変えたか” “いつキーを作ったか” | 不要な個人の会話内容 |

社内利用ルール

社内でのルールは、「禁止事項を明文化する」「承認が必要な使い方を決める」「教育でそろえる」の3点が効きます。

禁止事項の根拠はシンプルで、秘密情報や認証情報が漏れやすい現実があるからです。GitHubで秘密情報が約369万件検出されたという報告は、うっかりが“普通に起きる”ことを示しています。 さらに、盗まれた認証情報が侵害の入口になった割合が22%というデータもあり、認証情報まわりのルールは優先度が高いです。

運用面では、OpenAIのプロジェクト機能で「月次予算」や「通知しきい値」「モデル利用」をプロジェクトごとに設定できるため、ルールを仕組みで支えられます。また、APIキーの利用状況を追跡する仕組みがあり、一定の日付以降に作ったキーはトラッキングがデフォルトで有効という注意もあります。

外部連携(ツール呼び出し)での安全策

ツール呼び出しは便利ですが、いちばん事故が起きやすい場所です。OWASPは、LLMアプリの重大リスクとして「Prompt Injection(プロンプト注入)」を最上位に挙げています。さらにNCSC(英国の国の機関)も、プロンプト注入はSQLインジェクションとは違い、対策の考え方を間違えると守りが弱くなる、と注意しています。

ここで大事なのは、「モデルの出力をそのまま実行しない」です。OWASPはLLM02として、出力を十分に検証せずに下流の仕組みに渡す危険(Insecure Output Handling)を説明しています。

安全策は、次のように“仕組みで止める”方向が強いです。OpenAIの案内でも、ツール呼び出しはアプリ側で実行し、その結果をモデルに返す多段の流れとして整理されています。そしてMicrosoftのガイドでも、モデルが提案した関数呼び出しは必ず検証することが明記されています。

| 危険 | 起こりがちなこと | 先に入れる安全策 |

|---|---|---|

| 誤操作 | “削除” “確定” を勝手に実行 | 重要操作は人の確認を必須にする |

| 権限の過大 | 1つのキーで何でもできる | 読み取り専用ツールから始める |

| プロンプト注入 | 文書の中の命令にだまされる | ツールを許可リスト化し、引数を検査する |

| 出力のすり抜け | 生成文がそのままSQLやコードに入る | 構造化出力+サニタイズ+実行前検証 |

まとめ

セキュリティとガバナンスは、難しい技術より「先に決めること」と「仕組みで守ること」が効きます。個人情報・機密情報は“入れない”を基本にし、API側のデータ保持の前提(最大30日保持されうるログ、承認制のZero Data Retentionなど)を理解してルール化します。

APIキーは共有せず、クライアント側に置かず、最小権限とローテーションで守ります。ログは最小限でも残し、マスキングと保管期間を決めます。

外部連携(ツール呼び出し)は、プロンプト注入や不正な出力処理が大きなリスクなので、「モデルの出力をそのまま実行しない」「許可リストと引数検査」「重要操作は確認」を最初から入れるのが安全です。

本番運用の設計

ChatGPT APIを本番で回すときは、「止まる・遅くなる・高くなる・答えがブレる」は必ず起きる前提で設計すると安定します。具体的には、SLO(守りたい目標)を決めて監視し、エラー時はリトライやキューで吸収し、重要な業務は人の確認を入れ、段階リリースで被害を小さくしてから広げ、ログと評価で改善を回します。

SLO/監視項目

SLOは「ユーザー目線で、どのくらい安定していれば合格か」を数字で決めるものです。たとえば稼働率99.9%なら、30日あたり止まってよい時間は約43分という例が、Googleの信頼性チームの解説に出ています。

この“止まってよい枠”を「エラーバジェット(使ってよい失敗の予算)」として扱うと、「今は改善のために変更してよい」「今は危ないから変更を止める」が決めやすくなります。

また、外部サービスはどれだけ強くてもゼロ停止にはなりません。OpenAIのステータスページでも、一定期間(Nov 2025–Feb 2026)のAPI稼働率が表示されており、完全に100%ではないことが分かります。

だから監視は「落ちたか」だけでなく、「遅くなっていないか」「失敗が増えていないか」「費用が跳ねていないか」「出力が壊れていないか」まで見るのが現実的です。

レイテンシ(待ち時間)は、体感に直結します。ユーザー体験の古典的な基準として、0.1秒は“瞬時に反応したと感じる”目安、1秒は“考えの流れが途切れにくい”目安と説明されています。

API自体が速くても、ネットワークや端末で遅れるので、p95(95%地点)など“遅い側”も監視に入れると、苦情になる前に気づきやすいです。

SLOの考え方を、よく使う稼働率だけ表にするとこうなります。

| 稼働率の目標 | 30日あたりの停止許容量(目安) |

|---|---|

| 99.9% | 約43分 |

| 99.95% | 約22分 |

| 99.99% | 約4分 |

この表の数字は「目標を決めると、許される停止がどれくらいか」が直感的に分かる点が大きいです。

エラー時の設計

エラー設計で一番多い現実は、レート制限(429)です。OpenAIは、429対策としてランダムな指数バックオフ(少し待って再試行、だめならもっと待つ)を推奨しています。

さらに「1分あたり6万回」のような制限でも、短い時間に区切って(例:1秒あたり1000回)実装される場合があると説明されています。つまり“1分合計では超えていないのに、瞬間的に超えて落ちる”が起きます。

この性質があるので、入口でキューに入れて平らに流す設計は、混雑とスパイクに強くなります。

タイムアウトとリトライもセットで考えると失敗が減ります。OpenAIのガイドでは、公式SDKが408(Request Timeout)を2回自動でリトライする、と説明されています。

一方で、クライアント側のタイムアウトが長すぎると、ユーザーは待ち続けてしまいます。だから「UIは短めに諦めてフォールバック」「裏ではキューで続行して、あとで通知」のように、表と裏で設計を分けると運用しやすくなります。

人手レビューが必要な境界線

人手レビューの境界線は、「間違えたときのダメージ」で決めるのが一番分かりやすいです。たとえば情報漏えいは、発見まで平均194日、封じ込めまで平均64日という数字が示されており、気づくのが遅れやすい現実があります。

さらに、データ侵害の世界平均コストが約488万ドルという報告もあり、1回の事故が重いことが分かります。

だから「返金の確定」「契約の確定」「個人情報を含む送信」「在庫や予約の確定」「社外に出す公式文」などは、人の確認を必須にするほうが安全です。

逆に「下書きを作る」「分類して候補を出す」「要約して読む量を減らす」など、最終決定が人に残る仕事は、比較的自動化に向きます。重要なのは、モデルの出力をそのまま“実行”や“送信”に結びつけない線引きを、最初から決めておくことです。

段階リリース

段階リリースは「いきなり全員に出さない」だけで、事故の範囲を小さくできます。GoogleのSRE実践では、カナリアリリースとして“少しのユーザー(トラフィック)にだけ新しい版を当てて、問題がないか見てから広げる”考え方が説明されています。

このとき見るのは、先ほどの監視項目(エラー率・遅さ・コスト・品質)です。カナリアで悪化が見えたら、広げずに戻す判断がしやすくなります。

段階のイメージを表にすると、次のようになります。

| 段階 | 対象 | 合格の目安(例) |

|---|---|---|

| PoC | 自分だけ・少数データ | 期待どおり動く、費用が読める |

| 限定 | 一部の部署・一部ユーザー | エラー率と待ち時間が目標内、フォールバックが機能 |

| 全体 | 全社・全ユーザー | 監視と運用が回り、更新しても壊れにくい |

この「PoC→限定→全体」の順に進めると、学びを増やしながらリスクを抑えられます。

改善サイクル

本番は「作って終わり」になりやすいので、改善サイクルを仕組みにしておくと強いです。OpenAIはEvals(評価)のガイドで、プロンプトの回帰(変更で悪くなっていないか)を確認するやり方や、保存された出力を見て品質を追う考え方を紹介しています。

これを使うと「ログで異常を見つける」「評価で再現する」「プロンプトやモデルを直す」「また評価する」が回ります。

運用の見え方としては、ソフトウェアの世界でよく使われるDORA指標のように「変更でどれくらい失敗したか」を追う発想が役に立ちます。DORAのガイドでは、Change fail rate(変更の失敗率)などの定義が整理されています。

プロンプト変更やモデル変更も“変更”なので、変更後に「失敗率が上がった」「品質が落ちた」が見えたら、すぐに戻す判断ができます。そのために、ログには少なくとも「処理名」「モデル」「入力と出力の長さ」「エラーコード」「品質チェック結果(例:JSONが正しいか)」を残し、評価セット(期待回答)も少しずつ増やしていくのが現実的です。

まとめ

本番運用は、SLOを決めて監視し、エラー時はバックオフやキューで吸収し、重要業務は人の確認を必須にし、段階リリースで小さく試してから広げ、ログと評価で改善を回すと安定します。稼働率99.9%でも30日で約43分の停止が起こりうるように、ゼロ停止前提より“止まったときに崩れない設計”が強いです。

まとめ:ChatGPTのAPI活用を総括

ChatGPT API活用とは、社内ツールや業務システムから生成AIを「部品」として呼び出し、

文章作成・要約・抽出・分類・翻訳などを業務フローに組み込むことです。

成功の鍵はモデル選びより先に、

①入力をそろえる(テンプレ化)

②出力形式を固定する(JSONスキーマ等の構造化)

③人の確認点を決める(数字・固有名詞・禁止事項)

④保存/連携先を決める(DB、チケット、下書き箱)

という“前後の仕組み”を作ることです。

最小構成は、APIキーを安全に保管し、公式SDKで1リクエストを通し、

401/429/400の対策とストリーミング表示、薄いログ(誰がいつ何を投げ、遅延/失敗/費用)を

最初から用意します。

外部連携はツール/関数呼び出しで「モデルは提案、実行はアプリ」に分離し、

RAGで社内資料を検索して根拠付き回答に寄せます。

料金はトークン従量課金なので、

出力を短く・同一テンプレでキャッシュ活用・軽いタスクは軽いモデル・大量処理はバッチ等で

最適化します。

最後に、個人情報は入れない/最小権限/キー分離とローテーション/監視とSLO/段階リリース/評価(回帰テスト)

まで含めて、品質と安全を継続運用するのがプロの設計です。

特に重要なポイント(箇条書き)

- APIは「画面」ではなく「接続口」:業務フローへ組み込んで価値が出る

- 勝ち筋は“前後工程”:入力テンプレ → 生成 → 構造化 → 検証 → 保存/連携

- 構造化出力(JSONスキーマ等)で後段処理(DB/CSV/通知)を安定化

- 最小構成は「キー管理・エラー対策・ログ」(401/429/400、追跡可能に)

- ストリーミングで体感速度を改善し、待ちストレスを減らす

- ツール/関数呼び出しは分離が基本:モデル=提案、アプリ=実行(許可リスト+引数検査)

- RAGで根拠付き回答:社内資料を検索して“知ってるつもり”を減らす

- 料金はトークン従量:出力短縮、テンプレ固定(キャッシュ)、モデル使い分け、バッチで最適化

- 運用は“止まる前提”:SLO/監視、リトライ/キュー、フォールバック、段階リリース

- 品質は評価で守る:期待回答セット+回帰テストで更新に耐える